GPT4o来了,它到底是什么?

- GPT-4-OSH(GPT-4 Open Source Hub)可能是指一个基于GPT-4技术的开源项目或平台

- 致力于提供GPT-4模型的相关资源和工具

- 促进其在开源社区中的应用和发展

GPT-4-OSH(GPT-4 Open Source Hub)可能是指一个基于GPT-4技术的开源项目或平台,致力于提供GPT-4模型的相关资源和工具,促进其在开源社区中的应用和发展。虽然目前没有一个官方的“GPT-4-OSH”项目,以下是一个可能的概念说明:

GPT-4-O 概念

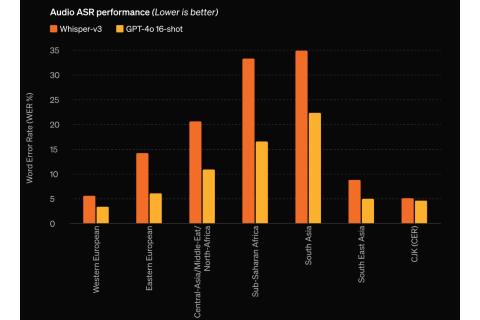

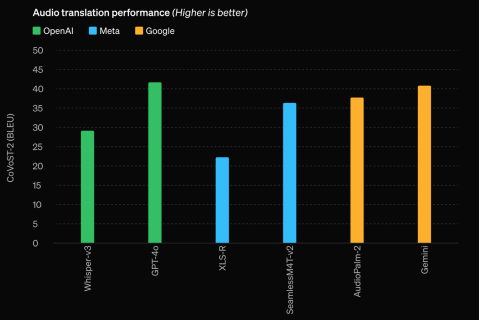

GPT-4o("o "代表 "omni")是向更自然的人机交互迈出的一步--它接受文本、音频、图像和视频的任意组合输入,并生成文本、音频和图像的任意组合输出。它能在 232 毫秒内对音频输入做出反应,平均反应时间为 320 毫秒,这与人类在对话中的反应时间(在新窗口中打开)相近。它在英语和代码文本方面的性能与 GPT-4 Turbo 相当,在非英语语言文本方面也有显著提高,同时在应用程序接口(API)方面速度更快,价格便宜 50%。与现有模型相比,GPT-4o 在视觉和音频理解方面尤其出色。

OpenAI的GPT-4 Omni(GPT-4o)是一种全新的人工智能模型,其名字中的"o"代表"omni",源自拉丁语中的词 “omnis”,意为“全面的”或“所有的”。这个模型标志着人机交互更自然化的一大步进。

GPT-4o是一个大型多模态模型,能够接受文本、音频和图像任意组合作的输入,并生成对应的任意组合输出。它采用了深度学习技术,在许多专业和学术基准测试中展现出人类水平的性能。

在音频方面,GPT-4o可以在短至232毫秒内响应用户的语音输入,平均320毫秒的响应时间已经接近人类在日常对话中反应速度。此外,该模型比其前身GPT-4快两倍,而价格仅为其50%。

在 GPT-4o 之前,使用语音模式与 ChatGPT 对话的平均延迟时间为 2.8 秒(GPT-3.5)和 5.4 秒(GPT-4)。为实现这一目标,语音模式是由三个独立模型组成的流水线:一个简单模型将音频转录为文本,GPT-3.5 或 GPT-4 接收文本并输出文本,第三个简单模型将文本转换回音频。这个过程意味着主要的智能源 GPT-4 会丢失很多信息--它不能直接观察音调、多人讲话或背景噪音,也不能输出笑声、歌声或表达情感。

通过 GPT-4o,我们在文本、视觉和音频方面端到端训练了一个新模型,这意味着所有输入和输出都由同一个神经网络处理。由于 GPT-4o 是我们第一个结合了所有这些模式的模型,因此我们在探索该模型的功能及其局限性方面仍处于起步阶段。

模型的安全性和局限性

GPT-4o 通过过滤训练数据和通过后期训练完善模型行为等技术,在设计上内置了各种模式的安全性。我们还创建了新的安全系统,为语音输出提供保护。我们根据准备框架和自愿承诺对 GPT-4o 进行了评估。我们对网络安全、CBRN、说服力和模型自主性的评估表明,GPT-4o 在这些类别中的得分均未超过中等风险。这项评估包括在整个模型训练过程中运行一套自动和人工评估。我们使用自定义微调和提示对模型的安全缓解前版本和安全缓解后版本进行了测试,以更好地激发模型的能力。

GPT-4o 还与 70 多名社会心理学、偏见与公平以及错误信息等领域的外部专家进行了广泛的外部红队合作,以识别新添加的模式所带来或放大的风险。我们利用这些经验制定了安全干预措施,以提高与 GPT-4o 互动的安全性。我们将继续降低发现的新风险。

我们认识到,GPT-4o 的音频模式会带来各种新风险。今天,我们将公开发布文本和图像输入以及文本输出。在接下来的几周和几个月中,我们将致力于技术基础设施、通过后期培训提高可用性以及发布其他模式所需的安全性。例如,在推出时,音频输出将仅限于选择预设的声音,并将遵守我们现有的安全政策。我们将在即将推出的系统卡中分享有关 GPT-4o 全部模式的更多细节。

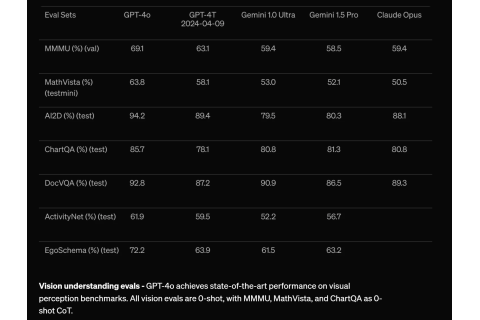

模型评估

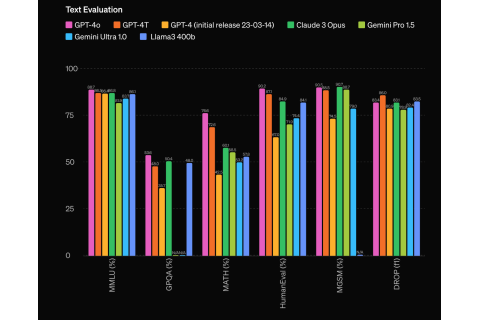

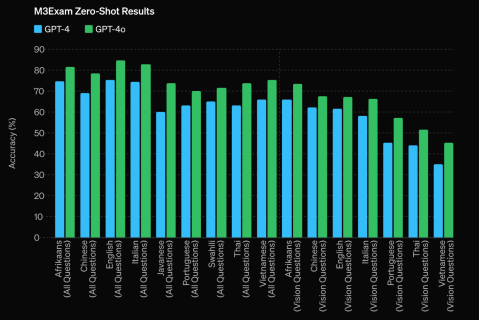

根据传统基准衡量,GPT-4o 在文本、推理和编码智能方面的性能达到了 GPT-4 Turbo 的水平,同时在多语言、音频和视觉能力方面创下了新高。模型可用性

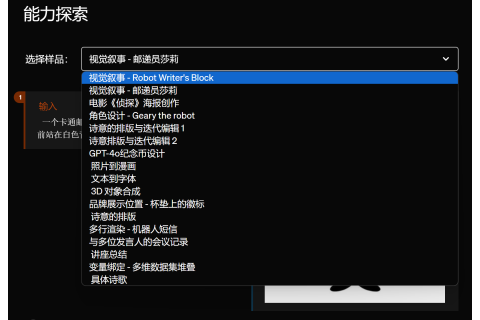

GPT-4o 是我们在推动深度学习发展方面迈出的最新一步,这一次是朝着实际可用性的方向迈进。过去两年中,我们花费了大量精力,致力于提高堆栈每一层的效率。作为这项研究的第一个成果,我们能够更广泛地提供 GPT-4 级模型。GPT-4o 的功能将迭代推出(从今天开始扩大红队访问权限)。GPT-4o 的文本和图像功能今天开始在 ChatGPT 中推出。我们将在免费层和 Plus 用户中提供 GPT-4o,信息限制最高可提高 5 倍。未来几周,我们将在 ChatGPT Plus 中推出带有 GPT-4o 的新版语音模式 alpha。

开发人员现在也可以在 API 中以文本和视觉模式访问 GPT-4o。与 GPT-4 Turbo 相比,GPT-4o 速度快 2 倍,价格便宜一半,速率限制高 5 倍。我们计划在未来几周内,在 API 中向一小群值得信赖的合作伙伴推出对 GPT-4o 的新音频和视频功能的支持。

0 评论